El modelo de IA sorprendentemente económico de Deepseek desafía las normas de la industria. Mientras que Deepseek cuenta con un mero costo de capacitación de $ 6 millones para su modelo V3 Deepseek, un aspecto más cercano revela una inversión mucho más sustancial.

Imagen: Ensigame.com

Imagen: Ensigame.com

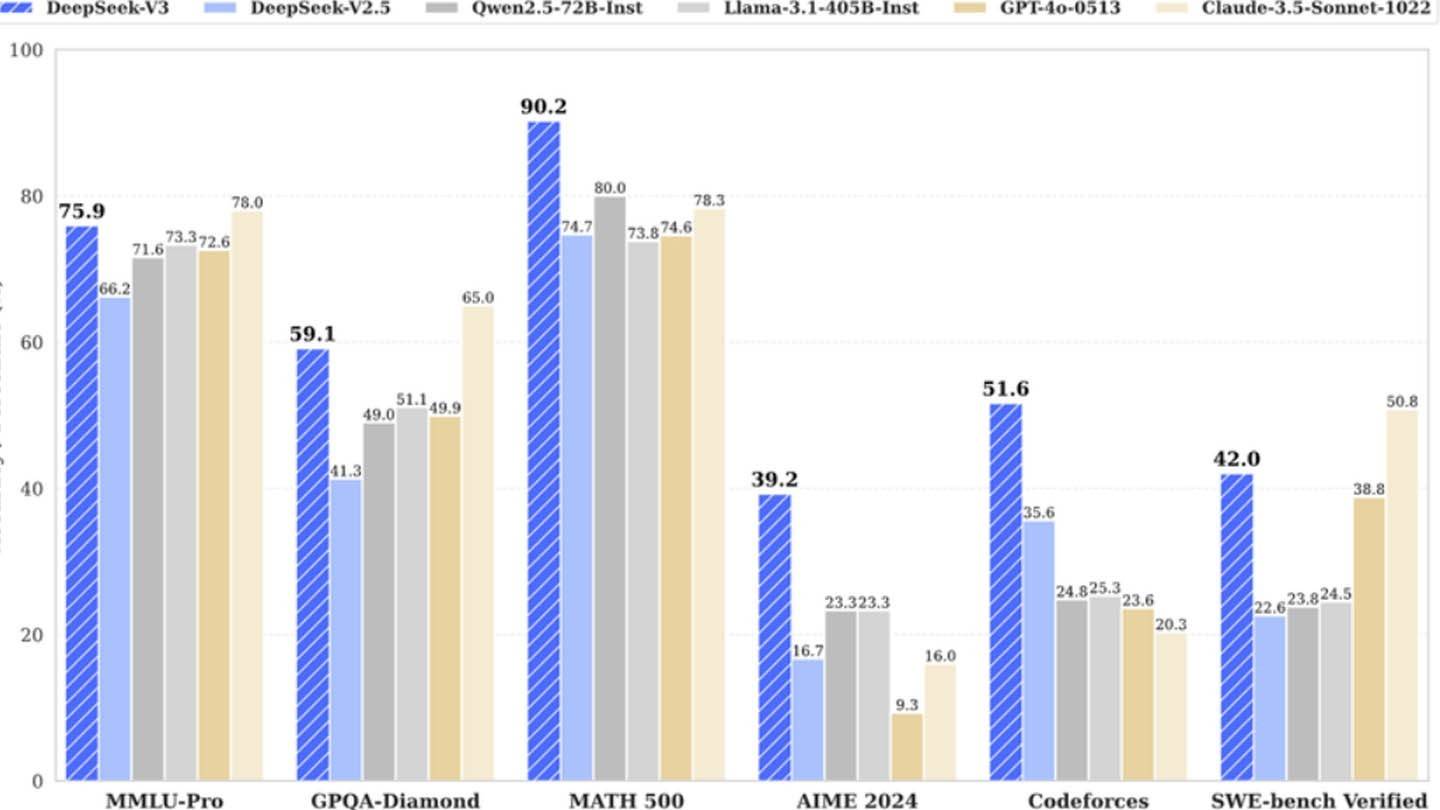

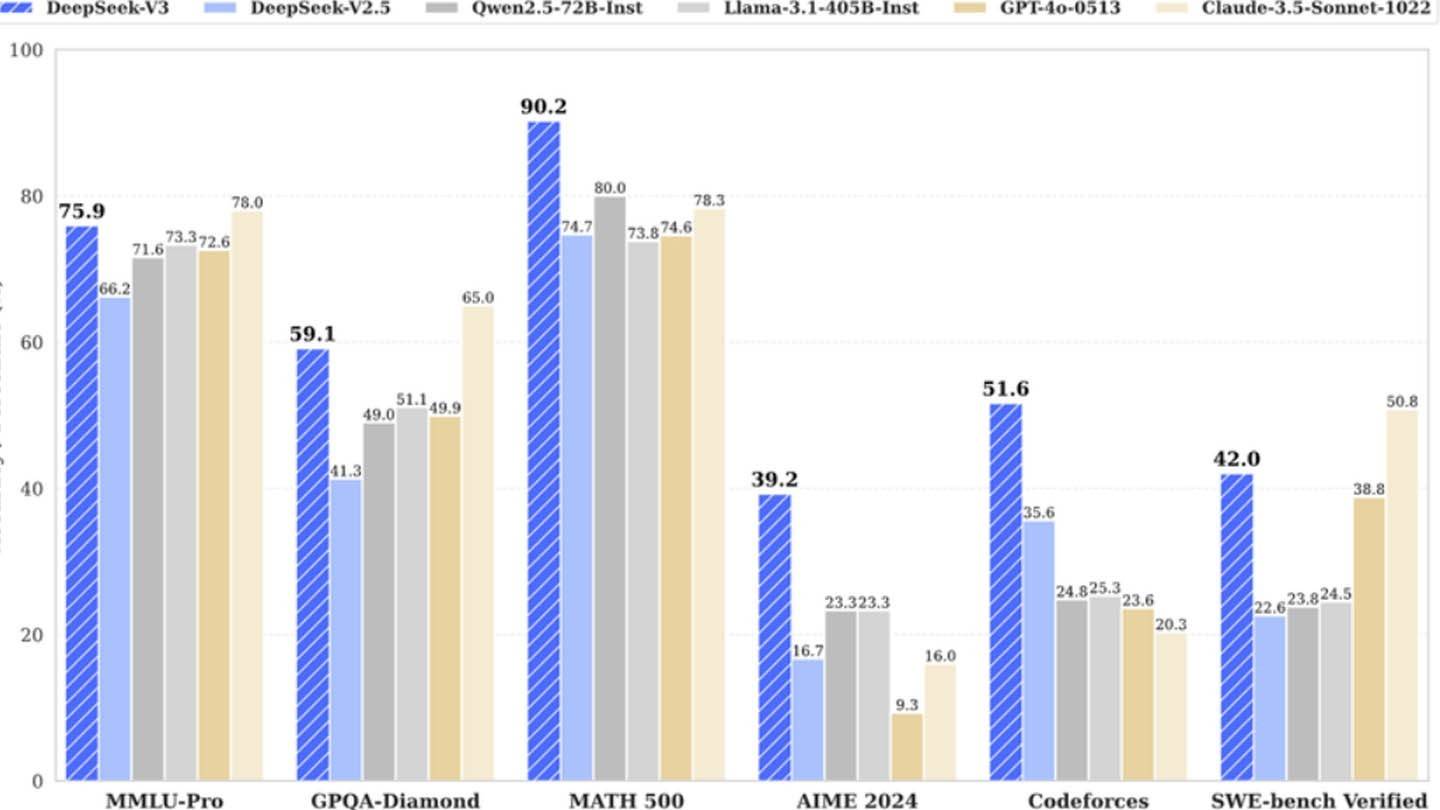

Deepseek V3 aprovecha tecnologías innovadoras: Predicción de múltiples token (MTP) Para predicción de palabras simultáneas, Mezcla de expertos (MOE) Utilizando 256 redes neuronales y Atención latente de múltiples cabezas (MLA) ** Para un enfoque mejorado en elementos de oración cruciales. Estos avances contribuyen tanto a la precisión como a la eficiencia.

Imagen: Ensigame.com

Imagen: Ensigame.com

Sin embargo, el semianálisis descubrió una discrepancia significativa. La infraestructura de Deepseek en realidad comprende alrededor de 50,000 GPU de Nvidia Hopper, una inversión de $ 1.6 mil millones con $ 944 millones en costos operativos. Esto contrasta fuertemente con la figura de capacitación publicitada de $ 6 millones, lo que solo refleja el uso previo de la GPU, excluyendo la investigación, el refinamiento, el procesamiento de datos e infraestructura.

Imagen: Ensigame.com

Imagen: Ensigame.com

Deepseek, una subsidiaria de High-Flyer, posee sus centros de datos, fomentando el control y la rápida innovación. Su estado autofinanciado y su altos salarios (más de $ 1.3 millones anuales para algunos investigadores) atraen el mejor talento chino. A pesar de la inversión de $ 500 millones en desarrollo de IA, su estructura simplificada permite una innovación eficiente.

Imagen: Ensigame.com

Imagen: Ensigame.com

Si bien el éxito de Deepseek muestra el potencial de las compañías de IA independientes bien financiadas, el reclamo de "presupuesto revolucionario" es engañoso. El verdadero costo es mucho más alto, pero aún significativamente menor que los competidores como ChatGPT4O, que según los informes costó $ 100 millones para entrenar, en comparación con los $ 5 millones de Deepseek para R1. La disparidad destaca la eficiencia de Deepseek a pesar de su inversión sustancial.

Imagen: Ensigame.com

Imagen: Ensigame.com Imagen: Ensigame.com

Imagen: Ensigame.com Imagen: Ensigame.com

Imagen: Ensigame.com Imagen: Ensigame.com

Imagen: Ensigame.com Últimos artículos

Últimos artículos