O modelo de IA surpreendentemente barato de Deepseek desafia as normas da indústria. Enquanto a Deepseek possui um mero custo de treinamento de US $ 6 milhões para seu modelo Deepseek V3, um visual mais próximo revela um investimento muito mais substancial.

imagem: ensigame.com

imagem: ensigame.com

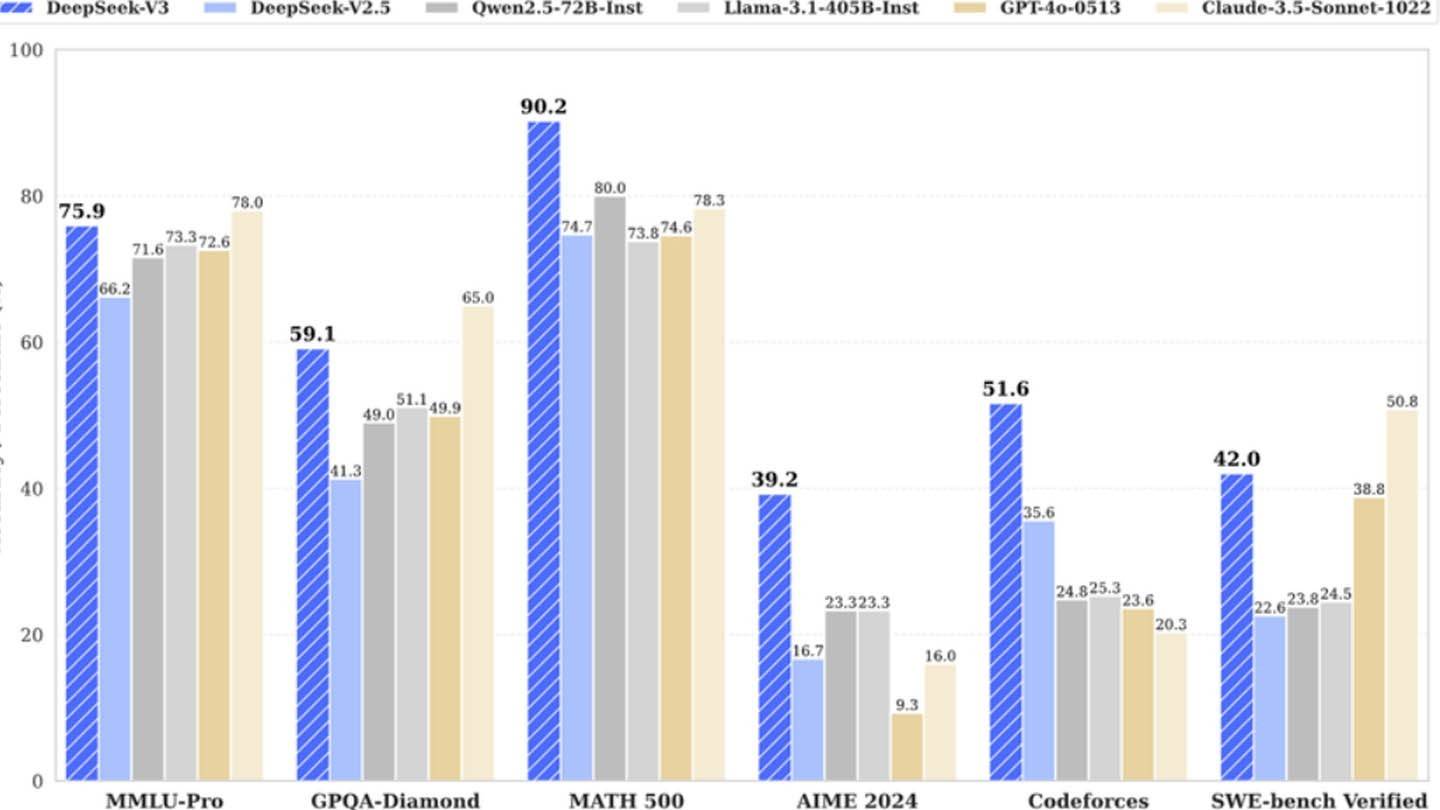

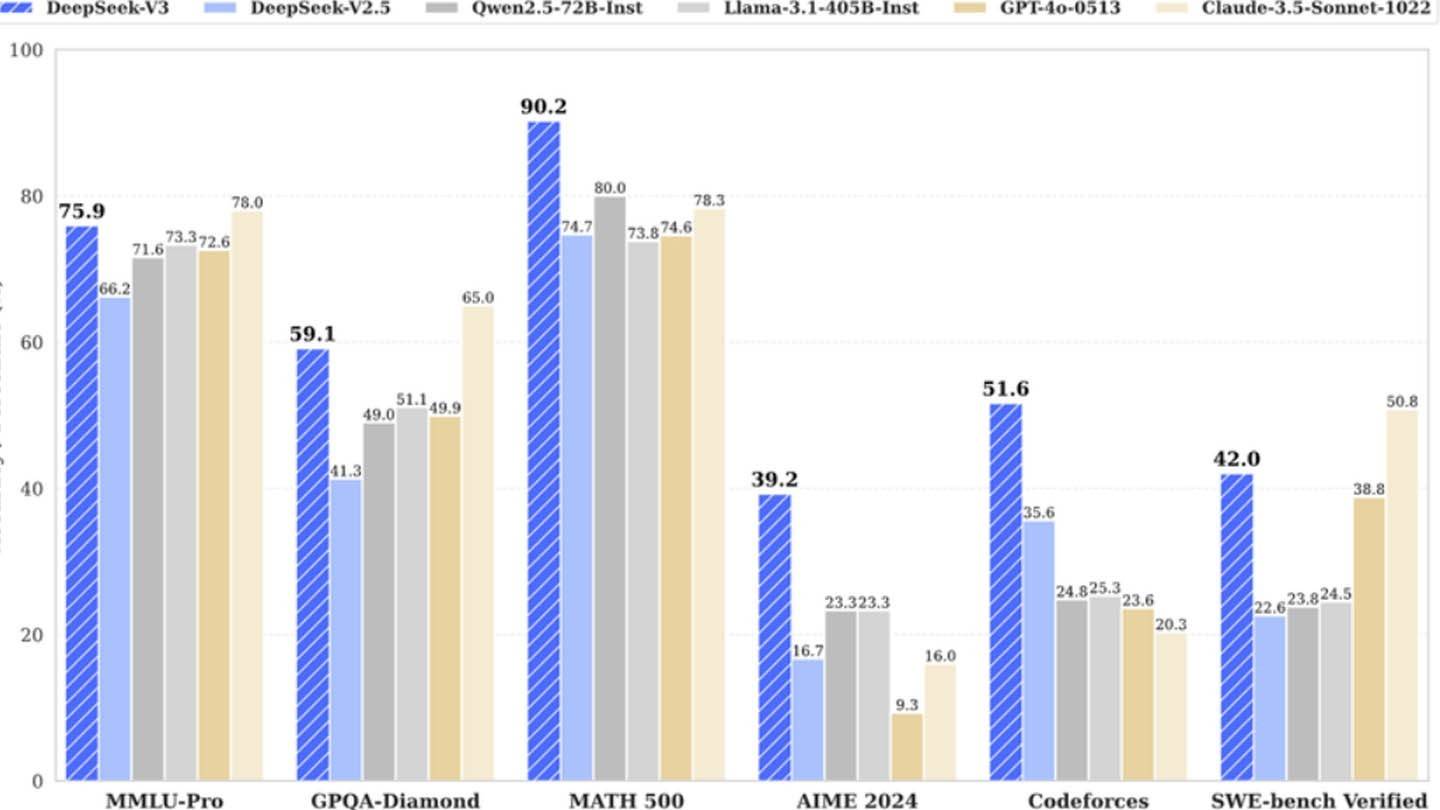

Deepseek V3 Aproveita tecnologias inovadoras: Previsão de vários toques (MTP) Para previsão simultânea de palavras, Mistura de especialistas (MOE) Utilizando 256 redes neurais e atenção latente de várias cabeças (MLA) Para um foco aprimorado nos elementos cruciais da frase. Esses avanços contribuem para a precisão e a eficiência.

imagem: ensigame.com

imagem: ensigame.com

No entanto, a semiânica descobriu uma discrepância significativa. Na verdade, a infraestrutura da Deepseek compreende cerca de 50.000 GPUs da NVIDIA Hopper, um investimento de US $ 1,6 bilhão com US $ 944 milhões em custos operacionais. Isso contrasta acentuadamente com o número de treinamento divulgado de US $ 6 milhões, que apenas reflete o uso de GPU pré-treinamento, excluindo pesquisas, refinamento, processamento de dados e infraestrutura.

imagem: ensigame.com

imagem: ensigame.com

A Deepseek, uma subsidiária da High-Flyer, possui seus data centers, promovendo o controle e a inovação rápida. Seu status autofinanciado e altos salários (mais de US $ 1,3 milhão anualmente para alguns pesquisadores) atraem os principais talentos chineses. Apesar do investimento de US $ 500 milhões no desenvolvimento da IA, sua estrutura simplificada permite inovação eficiente.

imagem: ensigame.com

imagem: ensigame.com

Embora o sucesso de Deepseek mostre o potencial de empresas independentes de IA bem financiadas, a reivindicação de "orçamento revolucionário" é enganoso. O custo verdadeiro é muito maior, mas ainda significativamente menor que os concorrentes como o ChatGPT4O, que supostamente custou US $ 100 milhões para treinar, em comparação com os US $ 5 milhões da Deepseek em R1. A disparidade destaca a eficiência da Deepseek, apesar de seu investimento substancial.

imagem: ensigame.com

imagem: ensigame.com imagem: ensigame.com

imagem: ensigame.com imagem: ensigame.com

imagem: ensigame.com imagem: ensigame.com

imagem: ensigame.com Artigos Mais Recentes

Artigos Mais Recentes